Daha önce defalarca söylenen ve “siber savaş geleceğin savaşı olacak” sözlerini teyit eden bir olay geçen hafta dünya gündemini sarstı. Uluslararası istihbarat, polis, asker ve hükümet birimlerine siber silah üreten ve satan #HackingTeam adlı İtalyan merkezli şirket geçen hafta hack’lenerek sistemlerinden 400GB boyutunda veri dışarı sızdırıldı. Bu kadar önemli miktarda veri içerisinde neler var diye baktığmızda;

- Siber silah satın alan ülkeler ve birimleri,

- Yapılan yazışmalar,

- Satılan siber silah içerinse bulunan 0-gün açıkları,

- Ajan olarak kullanılmak üzere üretilmiş yazılımlar,

- Ajan yazılımları satın alan ülkelere ait erişim bilgileri,

- …

HAFTALIK SİBER BULTEN RAPORUNA ABONE OLMAK İÇİN FORMU DOLDURUNUZ

[wysija_form id=”2″]Hacking Team kimdir?

Siber casusluk ve saldırı aracı olan Uzaktan Kontrol Sistemi (Remote Control System – RCS) yazılımını ve bu yazılımı hedef kitleye enjekte etmek için gerekli ajan yazılımları üreten İtalya, ABD ve Singapur’da ofisleri bulunan bir Siber Silah / Yazılım Üreticisi. Şirketin en önemli ürünü olan GALILEO adlı RCS yazılımı başlıca aşağıdaki fonksiyonlara sahip;

- Ziyaret edilen web sitelerinin adreslerini kaydetmek,

- Açılan, yazılan, değiştirilen dosyaları kaydetmek,

- Basılan tuşları kaydetmek,

- Yazıcıya gönderilen dokümanları kaydetmek,

- Internet üzerinden yapılan sesli görüşmleri (VoIP – Skype, Viber vs.) kaydetmek,

- Çalıştırılan programları kaydetmek,

- Mikrofondan ortam dinlemesi yapmak,

- Web kameradan ortam görüntüsü almak,

- Ekran görüntüsü alıp, kaydetmek,

- Mesajlaşma (Windows Live Messenger, Yahoo Messenger, Skype vb.) trafiğini kaydetmek,

- Şifre çalmak,

- Mobil cihazlarda telefon konuşmalarını kaydetmek ve dinlemek,

- Mail trafiğini izlemek,

- GPS ile konum bilgisi almak,

- Adres defteri ve kişi bilgilerini çalmak,

- …

- SİBER BÜLTEN FACEBOOK SAYFASINA GÖZ ATIN

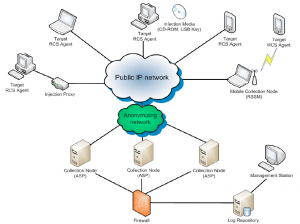

Görüldüğü üzere yapılan yazılım tamamen casusluğa yönelik saldırgan bir uygulama. Çalışma şeması aşağıdaki gibi kompleks ve servis sağlayıcılarla da entegre edilebilmekte. Bunun anlamı Network Injector modülü sayesinde bir hükümet ülke içerisinde istediği herhangi birinin bilgisayarına veya akıllı telefonuna sızabilir. Daha sonra yukarıdaki özelliklerden faydalanarak telefon dinlemesi, şifre çalma, konum bilgisi alma, ortam dinlemesi yapma ve web kamerasından bulunduğu yeri izleme gibi birçok kişisel gizliliği ihlal eden aktiviteler gerçekleştirilebilir.

İLGİLİ HABER >> TÜRKİYE HACKİNTEAM’IN AKTİF MÜŞTERİSİYMİŞ

Yazılım tehlikeli ama biz neden korkmalıyız?

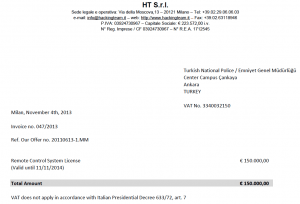

HackingTeam hack’lendikten sonra ortaya çıkan dokümanlardan Emniyet Genel Müdürlüğünün 2011’den 2014 yılının sonuna kadar bu yazılımı senelik 150.000 EURO (~450.000 TL) karşılığında satın aldığını öğrendik. Toplamda 600.000 EURO (1.8 Milyon TL) harcanan yazılımın bir fatura örneği aşağıdaki gibi;

Türkiye’de bu derece tehlikeli bir yazılımın kullanımını düzenleyen bir kanun bulunmuyor. Dolayısıyla yazılımın terör ve istihbarat maksadının haricinde kullanılması durumu söz konusu olabilir. Türkiye’de fuatavni hesabının yakalanması için herşeyin yapılabileceğini tahmin etmek zor değil. İsteyen birinin şifrelerimizi alması, bulunduğumuz ortamı dinlemesi hatta evimizin içini izlemesi kabul edilebilir bir durum değil. Bu sebeple bir vatandaş olarak rahatsız olmamak mümkün değil.

Ajan yazılım nedir? Benim bilgisayarımda yada telefonumda olabilir mi?

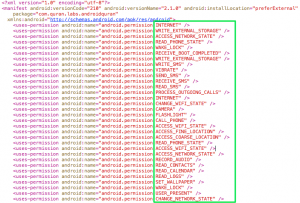

Ajan yazılım RCS komuta-kontrol-merkezinden gerekli direktifleri alıp buna göre hareket eden zararlı bir yazılım. Çoğumuz kendi halinde insanlar olarak zararlı yazılım indirip kullanmıyoruz diye düşünüyor olabilir, ancak ajan yazılımın üzerinde ‘AJAN’ yazmıyor zaten. Yaptığımız incelemelerde Android Quran (com.quran.labs.androidquran) adındaki bir Kur’an yazılımında ajan yazılım tespit ettik. Aynı şekilde Android Bible (joansoft.dailybible), Angry Birds (Hacking Team tarafından korsan marketlere yüklenen versiyonunda), Sound Recorder, SpyCam, Real Calc Plus ve bunun gibi birçok iOS ve Android yazlımının HackingTeam tarafından ajan olarak üretildiğini görüyoruz. Aşağıda bu yazılımlardan birinin telefonda talep ettiği izinler gösterilmiştir. Normal bir Kur’an uygulamasının SMS, kişiler, kamera, mikrofon gibi izinlere ihtiyacı olmaz, ancak bu uygulamanın sınırsız izinler istediğini görüyoruz.

Ben bu yazılımlardan herhangi birini kullanmıyorum, bu durumda güvende miyim?

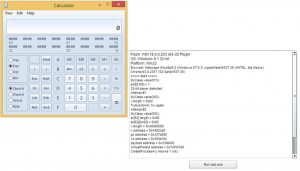

Ajan yazılımlar hedef kitleye ulaşmak için kullanılan yazılımların bir kısmı. HackingTeam arşivinde yaptığımız çalışmalar bunun haricinde Adobe Flash çalıştıran bilgisayarlara sızmak için kulanılan 0-gün (0-day) istismar kodlarının da şirket tarafından kullanıldığını gösterdi. Teknik olarak karışık gelse de demek istediğim en güncel Adobe Flash bile kullansanız, en güncel anti-virüs programına bile sahip olsanız bilgisayarınıza sızabilecek yollar mevcut.

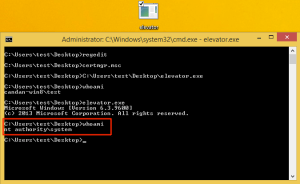

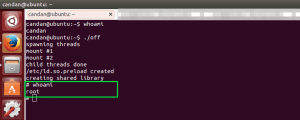

Benzer şekilde Windows 8+, Linux dağıtımlarının bir kısmında hak yükselme açıklarını da bulup kullandıklarını görüyoruz. Aşağıdaki iki resimde normal haklara sahip birinin kendisini en yüksek haklara sahip yönetici seviyesine nasıl yükseltebildiğini göstermeye çalıştık. Özet olarak RCS ajan yazılımının bu özellikleriyle herhangi bir kişinin bir siteyi ziyaret etmesiyle o kişinin bilgisayarında en yetkili kişi haline gelebilir.

Zafiyet barındıran herhangi bir uygulama (Adobe Flash dahil) veya crack uygulama kullanmıyorum, bu durumda güvende miyim?

RCS yazılımının en önemli özelliklerinden biri siz zararlı bir yazılım indirmek istemeseniz bile ajan yazılımı sizin legal yazılımınızın içerisine enjekte edebilmesi. Yani siz normal bir yazılım indirirken RCS yolda bu yazılımım içerisine ajan enjekte edip gönderiyor. Dolayısıyla indirilen legal(!) yazılımın kendisi ajan haline dönüşüyor.

Anti-virüs kullanıyorum, o engellemez mi?

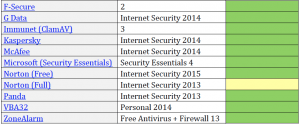

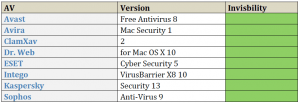

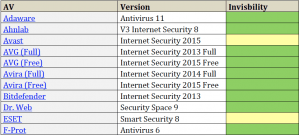

RCS ajan yazılımları birçok anti-virüs tarafından tanınmıyor. HackinTeam’in yaptığı testlerde de bunu görebiliyoruz. Yani anti-virüs de sizi bu konuda korumaya yetmiyor. Aşağıdaki resimlerde Windows ve Mac OS X üzerinde çeşitli Anti-Virüs yazılımlarından görünmeden çalışdığı test sonuçları yer almakta.

Benim bilgisayarıma veya telefonuma sızmış olabilirler mi? Nasıl bilebilirim?

Maalesef normal bir son kullanıcının bunu öğrenebilme şansı yok. Ancak ileri seviye hafıza (Memory) analizi ve adli analiz (Digital Forensic) yapabilen uzmanların bulabileceği bir ajan yazılımla karşı karşıyayız. Tabi bu seviyede bilgiye sahip insan sayısı Türkiye’de iki elin parmaklarından az.

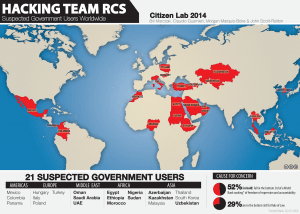

Bu yazılım sadece Türkiye’de mi var?

Hayır, yazılım bizim haricimizde Kıbrıs, Mısır, Suudi Arabistan, Macaristan, Meksika, Tayland, Nijerya gibi birçok ülke var. Ancak Amerika, İngiltere, Almanya, Rusya, Çin, Kanada, Fransa gibi hiçbir büyük ülkede yok. Muhtemelen bu yazılım kendi içerisinde bir arka kapı (backdoor) barındırıyor ve bu nedenle yazılımı alan ülkeler asıl yazılımı üreten ve destek veren büyük ülkelere hizmet ediyor olabilir. İronik!

Sonuç

Muhtemelen bu yazılımı alarak Türkiye olarak en büyük siber saldırıya maruz kalmış olabiliriz. Artık dinlemelerin nasıl yapıldığını tahmin etmek zor değil. Büyük bir devlet asla bu derece tehlikeli özellikleri barındıran bir siber silahı ülkesine ve ülkesinin network’üne bağlamaz. Böyle bir yazılımı kendi mühendisleriyle ve kaynak kodlarına hakim olarak hazırlar. Tıpkı diğer büyük ülkelerin yaptığı gibi…

Bu programın kullanılmasını fuatavni hesabının tespitiyle ilişkilendirmişsiniz ancak bana göre bu hiç iyi niyetli bir bakış açısı değil. Belgelerde emniyetin son anlaşmayı 4 Kasım 2013 tarihinde yaptığı yazıyor. O tarihte henüz fuatavni diye bir hesap olmadığı gibi daha 17 Aralık operasyonu dahi olmamıştı.

Aynı şeyi CNNTurk’te de söylediğinizi hatırlıyorum. Bu meseleyi neden bu şekilde yönlendirmeye çalıştığınızı merak ediyorum doğrusu.

Sayın Can Bekiroğlu tarihler konusunda oldukça yanılıyorsunz. Fuat Avni ilk olarak @fuatavni hesabıyla 18 Şubat 2013 tarihinde Twitter’a giriş yapmıştır. Son anlaşma 4 Kasım 2013. Yani hesap yayına girip, tweet’ler paylaşılmaya başlayalı tam 10 ay zaman geçmiş oluyor. Lütfen biraz araştırıp doğru yorumlar yapın. @fuatavni hesabı engellendikten sonra birkaç tane daha hesap açılmış ve yayına devam etmiştir. Siz hangi hesabı ne zaman takip ettiğinizi kesinlikle karıştırıyorsunuz.

Sayın Can Bekiroğlu tarihler konusunda oldukça yanılıyorsunz. Fuat Avni ilk olarak @fuatavni hesabıyla 18 Şubat 2013 tarihinde Twitter’a giriş yapmıştır. Son anlaşma 4 Kasım 2013. Yani hesap yayına girip, tweet’ler paylaşılmaya başlayalı tam 10 ay zaman geçmiş oluyor. Lütfen biraz araştırıp doğru yorumlar yapın. @fuatavni hesabı engellendikten sonra birkaç tane daha hesap açılmış ve yayına devam etmiştir. Siz hangi hesabı ne zaman takip ettiğinizi kesinlikle karıştırıyorsunuz.

Can beyle benzer bir kanıya ben de vardım. Polis bu yazılımları Fuat Avni (ve çetesi) gibi suçluları yakalamak için kullanabileceği gibi, PKK, çocuk istismarcıları vs. için de kullanıyordur tahminim. Fakat konuyu “Fuat Avni yakalanacak diye herkesi dinliyor bunlar” ‘a getireceksek iyi niyet göremiyorum bunda ben pek. Dünyada çoğu teşkilat bu gibi yazılımları gizli/açık kullanıyor zaten. Devlete güvenliğimiz için güvenmeyeceğiz de Fuat Avni’ye mi güveneceğiz?

Zannediyorum o tarihte fuatavni diye bir hesap yoktu demek yerine fuatavni diye bir hesaptan kimsenin haberi yoktu deseydim daha doğru olacaktı.

Aslında yazdıklarımda en önemli nokta, son anlaşmanın emniyet tarafından 17 Aralık öncesi yapılmış olmasıydı. Bu dönemde emniyetteki en güçlü grubun hangisi olduğunu ve bu grupla fuatavni hesabının ilişkisini göz önünde bulundurursak emniyetin fuatavni hesabının tespiti için bu aracı aldığı iddiasının ne kadar yanlış olduğunu anlayabiliriz.

Elimizde kimin dinlendiği, hangi talimatla dinlendiği gibi bilgiler yokken asla birilerine suç yüklemek istemiyorum. Ama Candan Bey’in şimdiden her yerde bu fuatavni meselesini ortaya atmasına da anlam veremiyorum. Çünkü mutlaka şu anki bilgilerimizle konuşmamız gerekirse işin doğrusu Candan Bey’in iddia ettiğinin tam aksi gibi görünüyor.

Ayrıca tutarlılık; Hacking Team’in casusluk yapmış olması ihtimali kadar fuatavni hesabını yöneten kişilerin devletin pek çok noktasından aldığı bilgileri ifşa etmesinden de rahatsız olmayı gerektirir.

I thoguht finding this would be so arduous but it’s a breeze!

mens,cuando dices “ellos” y “su zoo”, ¿sigues la teorÃa de Freixedo de que para los ET somos simples animales de granja? Conste que Freixedo, por su valor y su osadÃa, por su originalidad al lanzar estas ideas hace casi 40 años, merece todos mis respetos. No coincido mucho con él y, sin embargo, le respeto un montón. De hecho, mucha gente comparte estas ideas sobre los ET hoy en dÃa. Yo creo que ni todos buenos ni todos malos, y no sé por qué me pareció que tú también ibas en esa dirección. Saludos.

You do realize that you’ve suggested some form of linuxish gnome crapware to a person who uses iTunes on a Mac, right? You do understand that he’s looking for software, not bowel movements, right? I ask because, funnily enough, I could have sworn that you managed to miss the entire substance of the question. That’s impressive. It’s almost like the orderlies forgot to give you your meds.

Can bey Tebrikler. Güzel yorum. Hackingteam elde ettiği bilgileri satmış da olabilir. Bilemiyoruz ama milli bir yazılımımızın olması şart.

Ek olarak emaillerde polisin berkin elvan ismiyle exploit hazirlattigi da gorulmekte. Bu da fuatavni cabasi olamaz herhalde.

Neden? Dökümanı mı okudunuz?